lm studio에서 qwen3-coder-next 다운로드하기

대부분의 LLM agent를 개발할 때 성능 상의 이유로 OpenAI나 Gemini와 같은 상용 API를 활용하지만, 개발 과정에서 비용이 부담될 때 맥북에서 직접 오픈소스 모델을 돌려서 테스트하는 경우가 가끔 있습니다. 저는 주로 오픈소스 모델을 구동할 때 Ollama를 활용하는데요, HuggingFace에서 모델을 받고 직접 추론 서버를 만들어 서비스가 이를 활용하도록 구성해도 되지만, 당장 기능을 동작하게끔 해야 하는데 그정도의 노력은 과한경우가 많습니다. Ollama를 활용하면 쉽게 모델을 다운받을 수 있고, 서버까지 자동으로 실행해주며, Langchain과 쉽게 연결할 수 있다는 장점이 있습니다.

하지만 Ollama의 경우에도 아쉬운 점이 하나 있습니다. 바로 GGUF 모델만 지원하고 MLX 모델 기반 추론이 안된다는 점입니다.

같은 모델이어도 어떠한 방식으로 모델을 추론하냐에 따라 파일 형식이 다른데요, 엄밀한 비유는 아니지만 자동차에 비유하면 "범용 타이어와 특정 차종 전용 서킷 타이어"의 차이라고 할 수 있습니다. MLX는 macOS에서만 사용가능하지만, 일반적으로 GGUF 기반 파일보다 모델 추론 속도가 빠르다는 장점이 있습니다.

이 글에서는 이러한 이점을 누리기 위해 LM Studio를 활용하여 Qwen3-Coder-Next 모델의 MLX 버전을 다운로드하는 방법을 소개합니다.

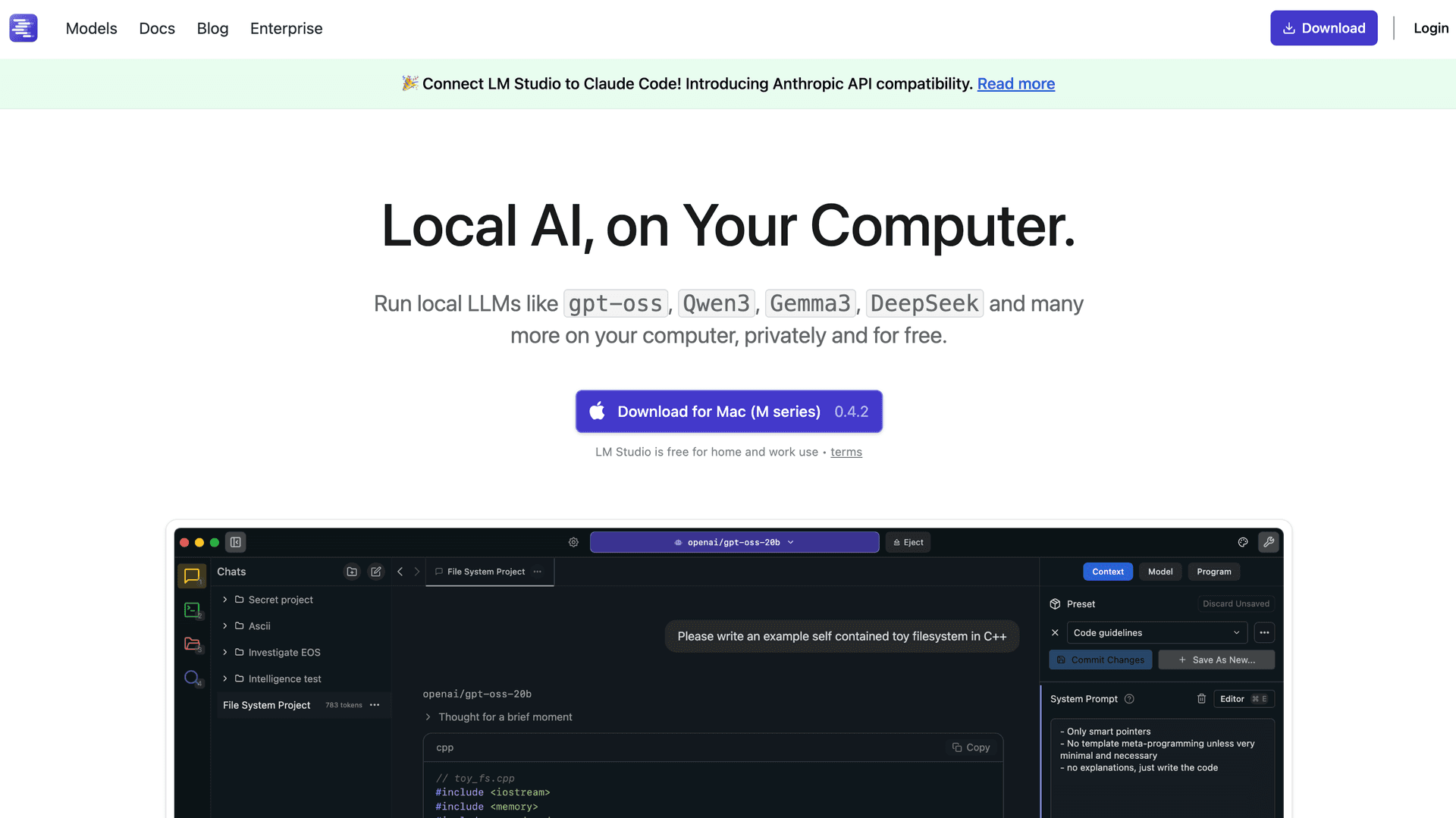

먼저 LM Studio가 없다면 다운로드를 해줘야겠죠?

lmstudio.ai 로 들어가줍니다.

로그인할 필요 없이 Download for Mac 버튼을 누르고 프로그램을 설치해줍니다. 맥북 사용자가 아니어도 프로그램을 다운 받을 수는 있지만 MLX 모델 구동의 이점을 누리긴 어려우니 참고하세요. LM Studio는 GGUF 기반 모델들도 다운로드 및 추론을 지원하기에 사용 자체를 못하는 것은 아닙니다.

프로그램에서 튜토리얼을 과감히 skip하셔도 좋고, 하나씩 읽어보셔도 좋습니다. 저는 이미 설치를 완료하여 튜토리얼부터 보여드리지는 못하지만 따라오는데에는 문제가 없으실거에요.

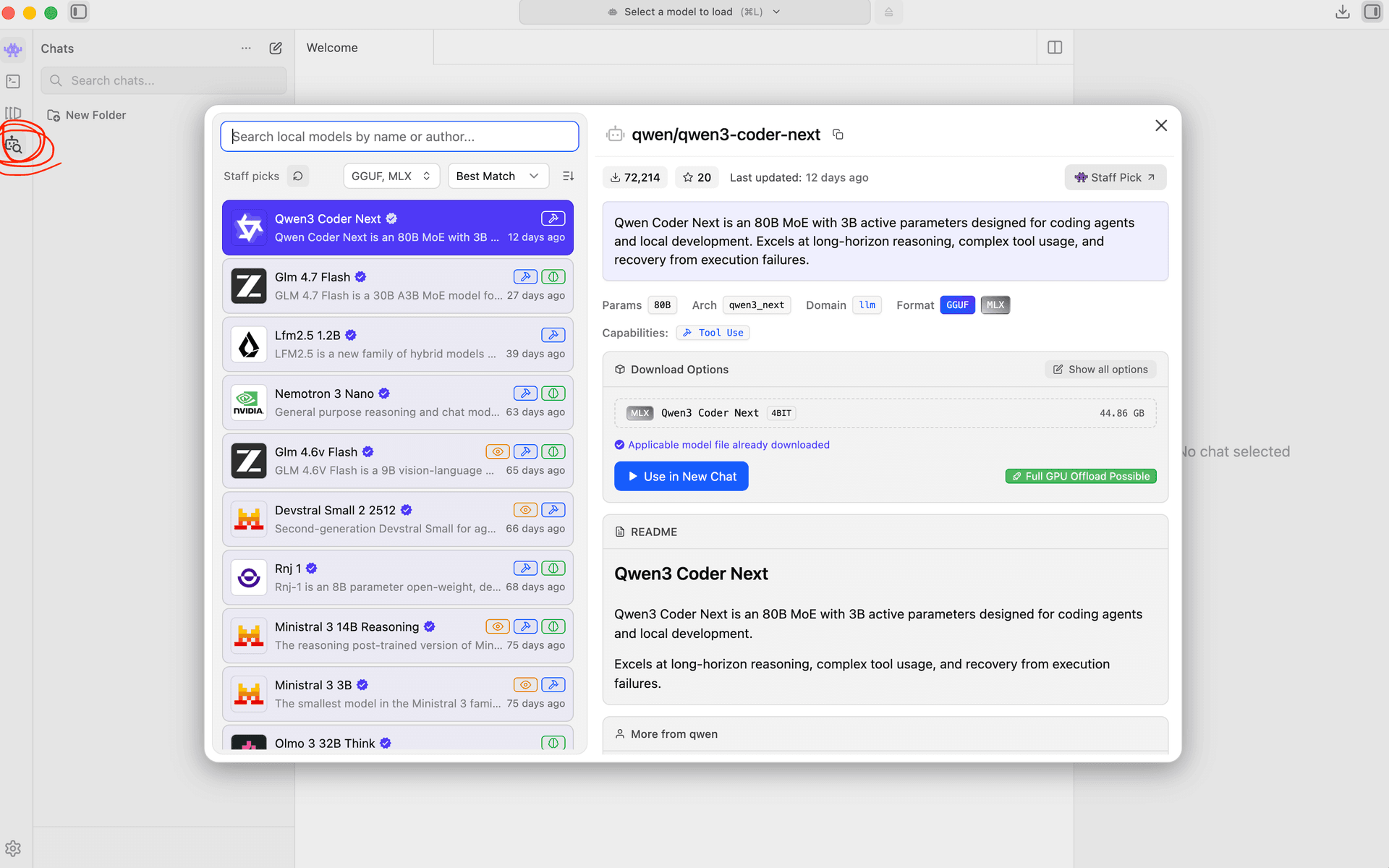

좌측 상단에 빨간색 동그라미가 표시된 버튼을 눌러주시면 다음과 같은 화면이 뜹니다. 해당 창의 검색창에서 원하는 모델을 검색하고 다운로드하면 됩니다.

해당 게시글에서는 Qwen3-coder-next의 mlx 모델을 설치하기로 했으므로 검색창에 qwen라고 검색해주겠습니다. (이미 설치되어있음 주의)

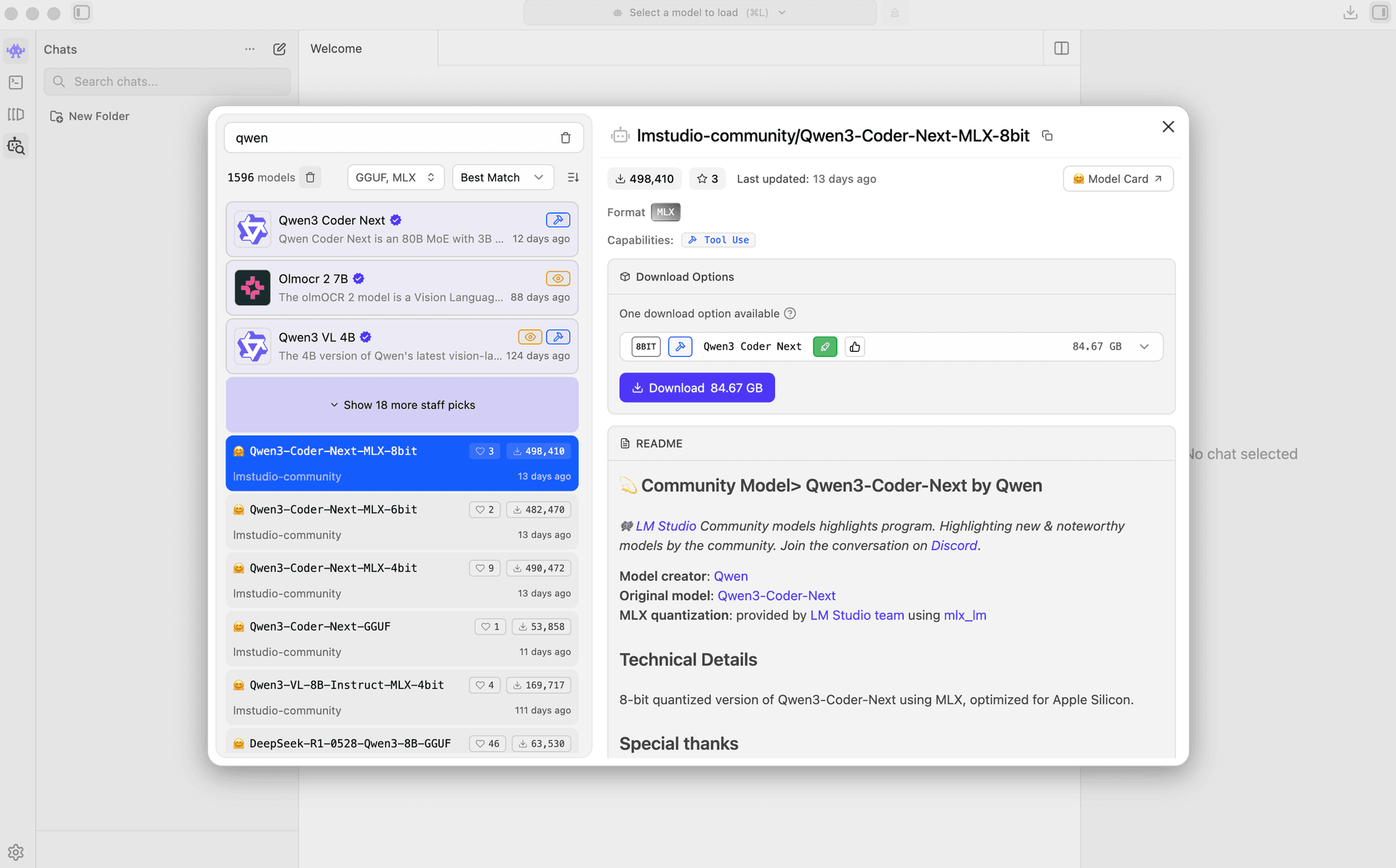

바로 상단에 Qwen3 Coder Next가 보입니다. 제가 4bit 양자화 모델은 이미 다운로드한 상태라, 8bit 모델을 선택해서 다운로드 버튼이 있는 모습을 보여드립니다. 설치 전에 반드시 Format이 MLX가 맞는지 확인하시고, 모델 사이즈가 메모리(RAM)의 크기에 근접하거나 뛰어넘지 않는지 확인하시고 Download 버튼을 눌러 설치하시면 되겠습니다.

같은 모델, 같은 파라미터라면 양자화가 많이 되어 있을수록 모델 크기가 감소합니다. 대신 그만큼 trade off로 정확도가 감소하겠죠. 하지만 컴퓨터의 VRAM(macOS에서는 공유 메모리, RAM) 용량에 맞는 모델을 선택하는 것이 중요합니다. 용량을 넘는 모델을 선택해도 추론이 가능하기는한데, 메모리 swap이 미친듯이 발생하며 컴퓨터의 수명을 깎음과 동시에 매우 느린 추론 속도를 경험하실겁니다.

4bit >> 8bit >> 16bit 내림차순으로 양자화가 많이 되어있으니 혹시 양자화를 처음 접하시는 분들은 참고하시면 되겠습니다.

이렇게 모델을 다운로드한다고 바로 사용가능한 것은 아닙니다. Ollama의 경우 모델만 선택하면 요청시 알아서 모델을 메모리에 올리며 서버로서 동작하지만, LM Studio는 사용자가 직접 모델을 load 해주어야합니다. 이게 불편하다고 느껴질 수 있지만 마냥 단점만 있는 것은 아닌게, Ollama의 경우 Ollama 서버에 요청이 계속 들어오지 않으면 자체적으로 AI모델을 메모리에서 내려버리는 경우가 종종 있는데, 이 때 새로운 요청이 들어오면 모델을 메모리에 올리는 시간이 추가적으로 소요됩니다. 반면 LM Studio는 한 번 모델을 메모리에 올려놓으면 사용자가 모델을 내리기 전까지 계속 올라가있기에 매 요청마다 모델을 메모리에 올리는 오버헤드가 없습니다. 물론 사용이 끝나면 사용자가 직접 모델을 메모리에서 내려주어야하는 단점이 있습니다. (Eject)

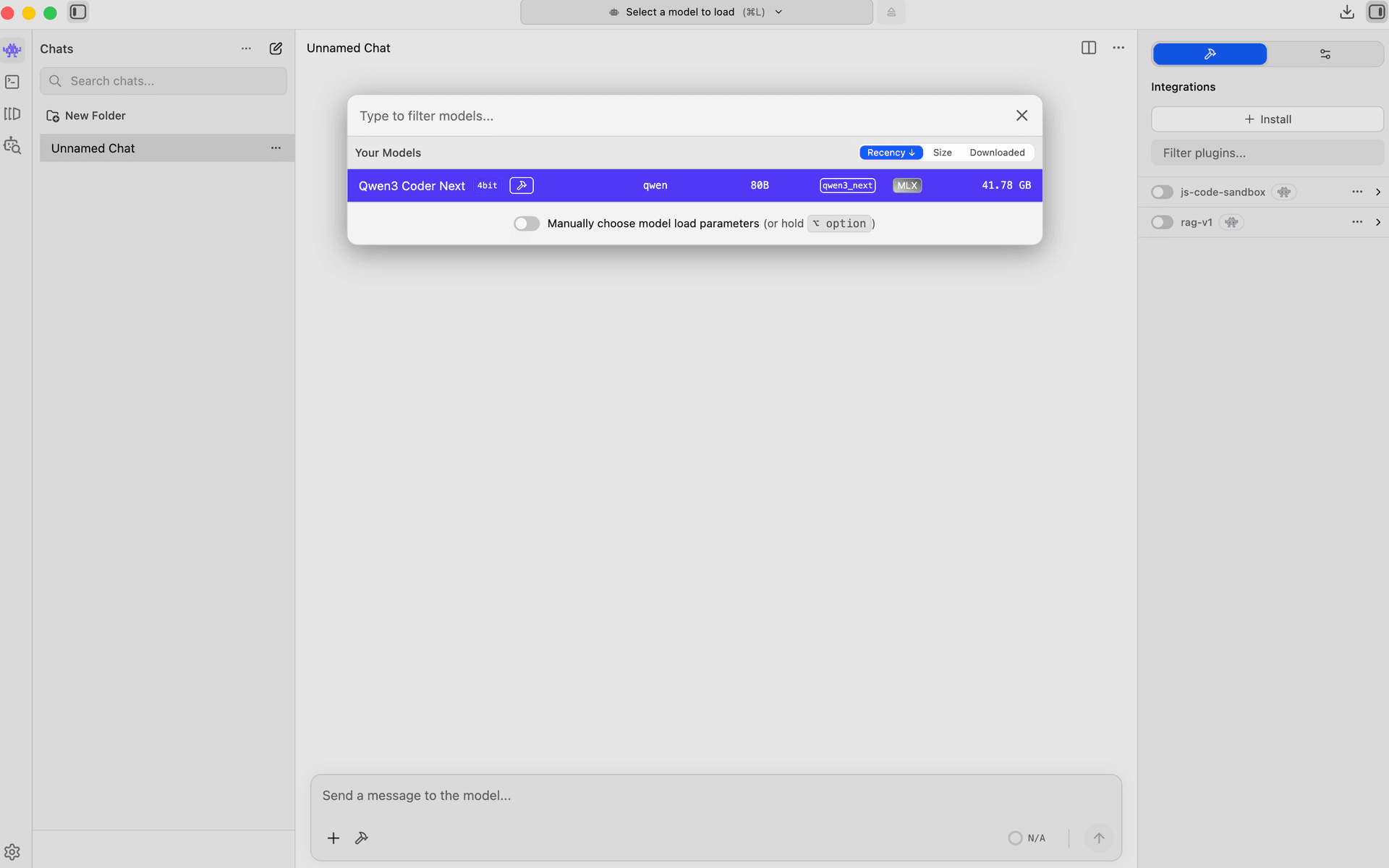

좌측 상단의 제일 위에 있는 캐릭터 버튼을 누르고, 상단의 Select a model to load를 클릭하면 다음과 같은 화면이 나옵니다.

다운로드한 모델을 클릭해서 load 해줍니다. 이 작업은 용량이 큰 파일을 메모리에 올리는 것이기에 시간이 좀 걸립니다.

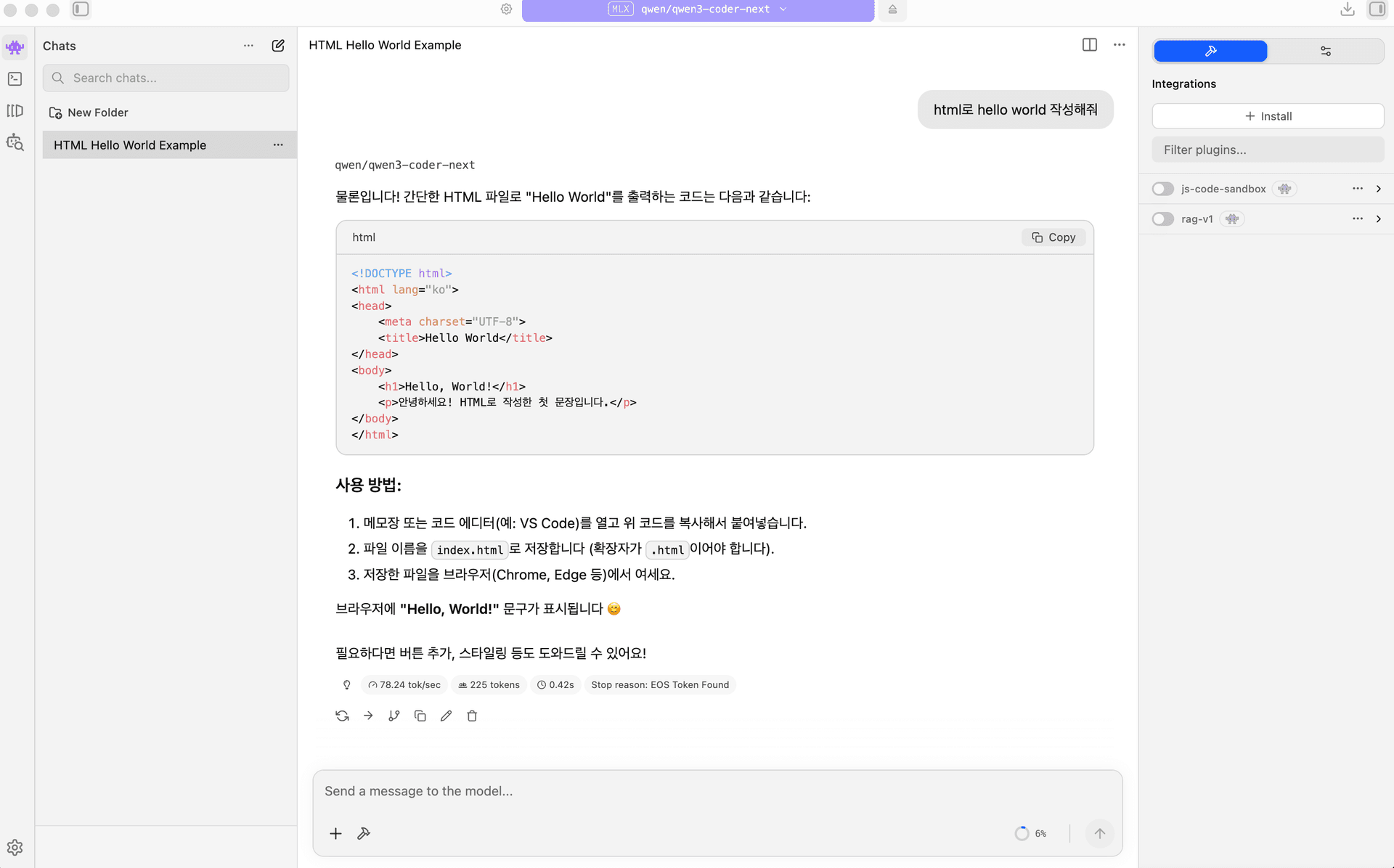

모델 load가 완료되면 LM Studio 내에서 채팅을 할 수 있습니다.

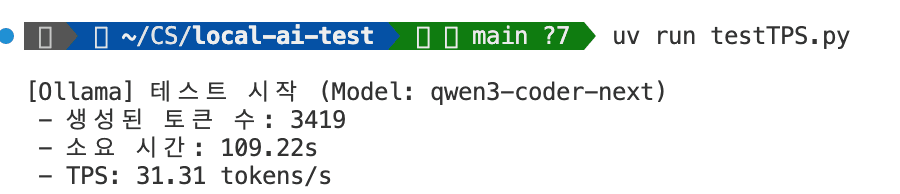

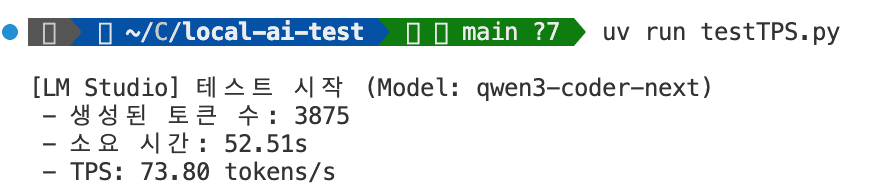

"html로 hello word 작성해줘"라는 간단한 작업을 시켜봤는데 78.24 TPS(token per seconds)로 로컬 모델치고 상당히 빠른 추론 속도를 보여줍니다.

같은 모델을 Ollama에서 실행(gguf)한 것 보다 약 1.5배에서 2배 가까이 빨랐습니다.

혹시나 테스트한 컴퓨터의 성능이 궁금하실까봐 맥북 스펙과 AI 모델명 알려드립니다.

GPU : M4Max

RAM : 128GB

모델 : qwen3-coder-next 80B (4bit 양자화) (MLX)

모델 크기 : 41.78GB

이렇게 LM Studio를 설치하고 모델을 다운로드 하는 방법을 알아봤습니다.

이를 기반으로 서버를 실행해 llm agent 개발 시 활요할 수도 있고, qwen3-coder-next 와 같은 모델을 claude code에 이어붙일 수도 있는 등 유용하게 활용이 가능합니다.

자세한 방법은 차차 소개해 보겠습니다. 다음에는 LM Studio에서 추론 서버를 실행하는 방법을 소개해 보겠습니다. 감사합니다.